VPS NVMe là gì? So sánh hiệu năng thực tế giữa VPS NVMe và VPS SSD (2026)

2 giờ sáng, hệ thống giám sát Zabbix hoặc Uptime Kuma của bạn liên tục đẩy cảnh báo đỏ qua Telegram. Lượng traffic từ chiến dịch marketing mới đổ về ồ ạt, ứng dụng web bắt đầu có dấu hiệu quá tải, API liên tục trả về lỗi 504 Gateway Timeout. Bạn tức tốc SSH vào server, gõ lệnh htop để kiểm tra tài nguyên và thấy một sự thật ngang trái: CPU mới chỉ load 20%, RAM vẫn còn dư dả hàng Gigabyte, nhưng Load Average lại cao ngất ngưởng. Nhìn kỹ hơn, cột wa (I/O wait) đang đỏ lừ.

Hệ thống của bạn không hề thiếu sức mạnh tính toán, nó đang bị nghẽn nghẹt ở khâu lưu trữ. Những ổ cứng SSD chuẩn SATA từng được coi là nhanh nhẹn giờ đây đang bắt CPU của bạn phải xếp hàng dài chờ đợi để đọc/ghi từng block dữ liệu vào Database. Đây chính là lúc giới kỹ thuật, từ các Software Engineer cho đến Sysadmin, phải tìm đến VPS NVMe như một giải pháp đắc lực để cứu vãn hiệu năng toàn hệ thống.

Vậy chính xác thì VPS NVMe là gì? Tại sao các hệ thống lớn đều đang rục rịch migrate khỏi SSD truyền thống để lên hạ tầng NVMe? Và liệu những con số benchmark hào nhoáng có thực sự mang lại giá trị khi áp dụng vào môi trường production? Quan trọng hơn, bạn đã thực sự hiểu cơ chế con trỏ vòng (circular buffer) trong kiến trúc đa hàng đợi, hay sự khác biệt chí mạng giữa PCIe lane của CPU và Chipset chưa? Hãy cùng mổ xẻ chi tiết những góc khuất kỹ thuật này ngay dưới đây.

Nút thắt cổ chai I/O: Khi CPU khỏe nhưng hệ thống vẫn quá tải

Trước khi tìm kiếm giải pháp, chúng ta cần nhìn thẳng vào cốt lõi của hạ tầng. Khi một ứng dụng scale lên và lượng request tăng vọt, phản xạ đầu tiên của nhiều quản trị viên là mở rộng quy mô tính toán (Scale-up) bằng cách nâng cấp thêm vCPU hoặc cắm thêm RAM cho server. Tuy nhiên, họ nhanh chóng nhận ra ứng dụng vẫn phản hồi chậm chạp.

Vấn đề nằm ở Bottleneck I/O (Nút thắt cổ chai đọc/ghi). Mọi thao tác từ ghi log hệ thống, update session người dùng, cho đến những câu truy vấn phức tạp (complex queries) trong MySQL hay PostgreSQL đều đòi hỏi truy xuất trực tiếp xuống ổ cứng.

Ổ cứng SSD SATA truyền thống sử dụng giao thức AHCI, một tàn dư kiến trúc từ thời kỳ của ổ cứng đĩa từ (HDD). Dù chip nhớ NAND Flash bên trong SSD có tốc độ siêu việt đến đâu, luồng dữ liệu vẫn phải đi qua một cái cổng quá hẹp. CPU của bạn, bộ não có khả năng xử lý hàng tỷ phép tính mỗi giây, cuối cùng lại phải chuyển sang trạng thái nhàn rỗi chờ đợi (I/O wait) chỉ vì ổ cứng không kịp truyền tải dữ liệu lên. Đó là sự lãng phí tài nguyên khủng khiếp, khiến toàn bộ hệ thống bị trì trệ.

Tình trạng nghẽn I/O (Bottleneck) xảy ra khi CPU xử lý tốc độ cao nhưng phải chờ đợi luồng dữ liệu chậm chạp từ chuẩn SATA.

Định nghĩa chuẩn xác: VPS NVMe là gì và khác biệt cốt lõi

Nhiều người thường nhầm lẫn khi gọi chung VPS NVMe như một công nghệ nguyên khối. Trên thực tế, thuật ngữ này là sự kết hợp giữa hai khái niệm hoàn toàn tách biệt:

- VPS (Virtual Private Server): Máy chủ ảo cung cấp tài nguyên độc lập (vCPU, RAM) được chia tách từ một node máy chủ vật lý thông qua Hypervisor.

- NVMe (Non-Volatile Memory Express): NVMe là một giao diện cho phép phần mềm máy chủ (host software) giao tiếp với hệ thống bộ nhớ không bay hơi (NVM subsystem).

Điểm đột phá làm nên sức mạnh của NVMe nằm ở tính độc lập với phương tiện lưu trữ vật lý (Media Agnostic). Đặc tả NVMe không giới hạn hệ thống phải dùng ổ cứng thể rắn (SSD), mà nó có thể là bộ nhớ đệm, Persistent Memory, hay bất kỳ công nghệ lưu trữ nào trong tương lai. NVMe trừu tượng hóa hoàn toàn các tác vụ quản lý vật lý nội bộ (như thuật toán wear leveling hay garbage collection của chip NAND).

Nói một cách chính xác, VPS NVMe là các máy chủ ảo được triển khai trên nền tảng cụm máy chủ sử dụng hạ tầng lưu trữ kết nối qua giao thức NVMe, giúp giải phóng hoàn toàn giới hạn tốc độ truyền tải.

- Xem thêm: Cloud VPS là gì? So sánh ưu điểm của Cloud VPS và VPS vật lý thông thường – VPS Chính hãng

Không chỉ giới hạn ở bo mạch chủ: PCIe và NVMe-oF

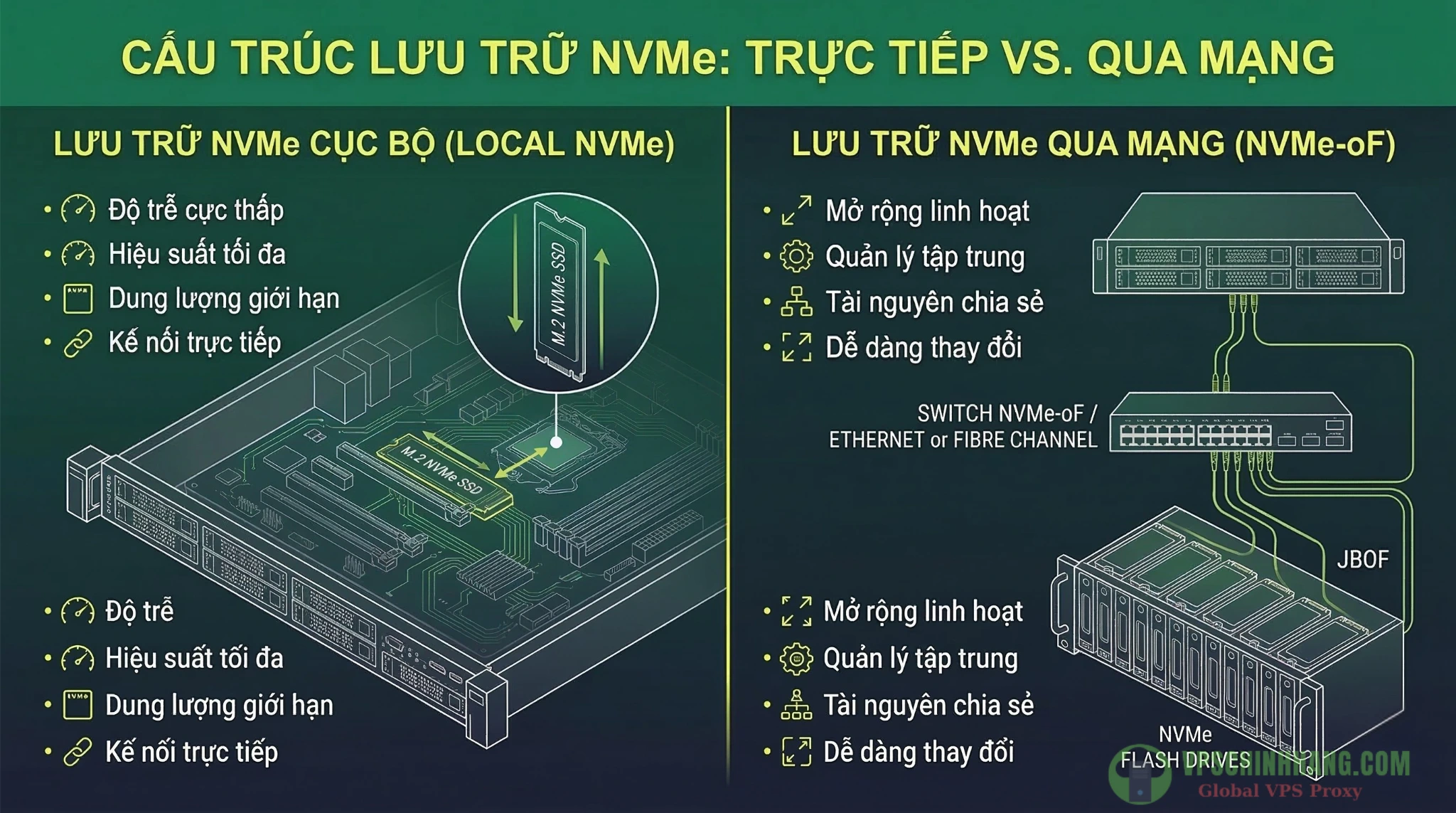

Một sai lầm phổ biến là cho rằng NVMe bắt buộc phải cắm trực tiếp trên mainboard. Thực tế, lớp truyền tải NVMe (NVMe Transport) hoạt động độc lập với kết nối vật lý và được chia làm hai mô hình chính:

- Mô hình truyền tải dựa trên bộ nhớ (Memory-Based Transport): Sử dụng các thao tác đọc/ghi bộ nhớ tường minh, tiêu biểu nhất là cắm trực tiếp qua luồng PCI Express (PCIe) (Local NVMe). Tốc độ cực nhanh, độ trễ cực thấp, nhưng dữ liệu mang tính ephemeral (phù du), dễ mất nếu node vật lý sập. Thường dùng làm Cache, TempDB.

- Mô hình truyền tải dựa trên tin nhắn (Message-Based Transport): Giao tiếp qua các capsule/tin nhắn, tiêu biểu là NVMe over Fabrics (NVMe-oF). Dữ liệu được truyền qua Fibre Channel, RDMA, hoặc TCP/IP. Kiến trúc này tạo ra các Networked Block Storage (như AWS EBS hay GCP Persistent Disk) cho phép lưu trữ dữ liệu vĩnh viễn, an toàn, hỗ trợ snapshot và High Availability (HA) với độ trễ chỉ nhỉnh hơn Local NVMe một chút.

Phân biệt kiến trúc Local NVMe (tối ưu tốc độ tuyệt đối) và NVMe-oF (tối ưu an toàn dữ liệu và High Availability).

Tùy vào nhu cầu là IOPS thuần túy hay sự an toàn dữ liệu, khi tìm mua VPS giá rẻ phù hợp với nhu cầu, bạn cần hỏi rõ nhà cung cấp VPS xem họ đang cấp phát Local NVMe hay Networked NVMe.

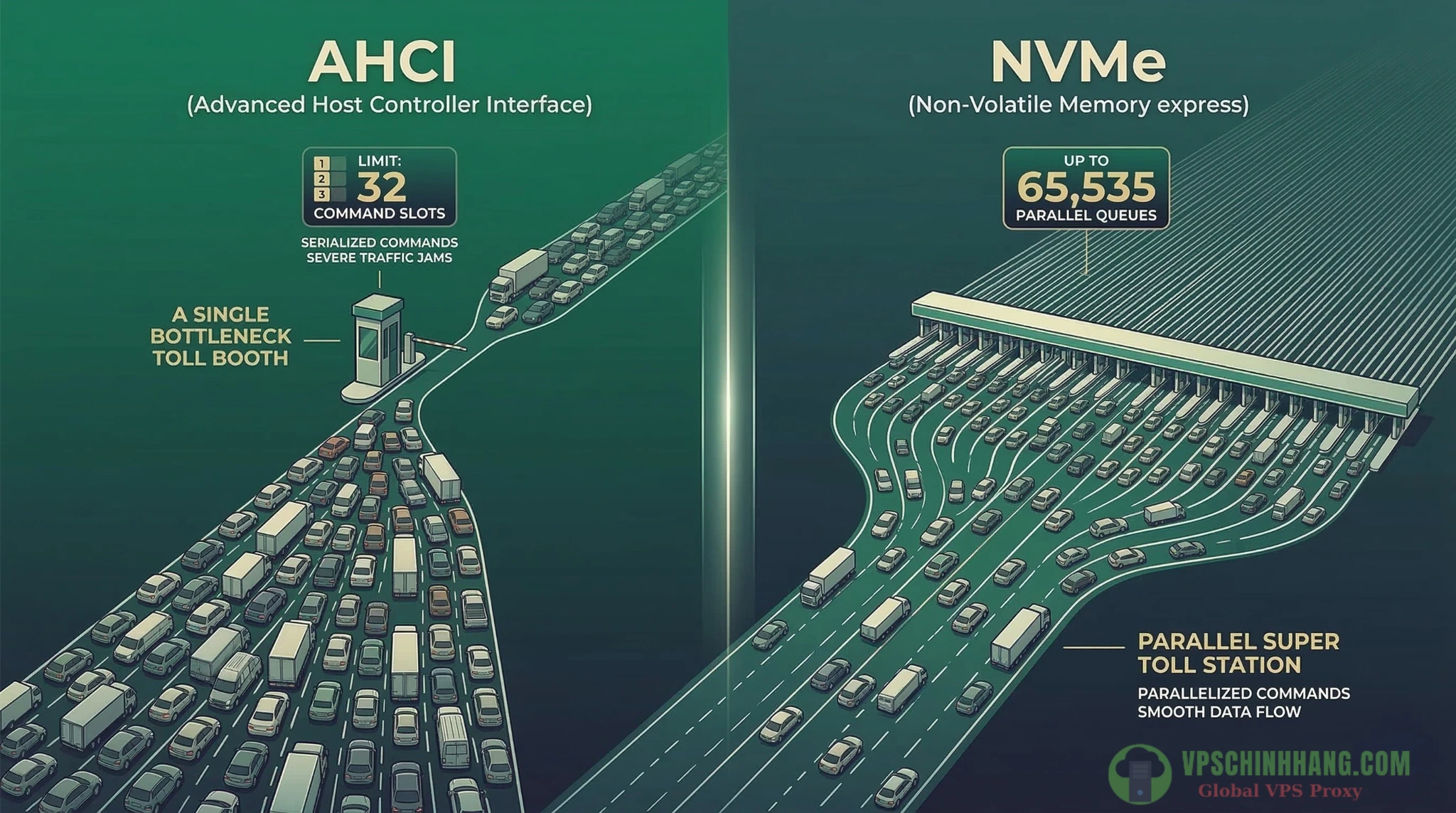

Sự tiến hóa của kiến trúc: AHCI vs NVMe multi-queue

Sự khác biệt rõ rệt nhất để chứng minh sức mạnh của NVMe so với chuẩn cũ nằm ở kiến trúc Hàng đợi lệnh (Queue Depth). AHCI được thiết kế cho ổ đĩa quay có độ trễ cao, trong khi NVMe sinh ra để vắt kiệt băng thông của Flash memory.

- Chuẩn AHCI (SATA): Chỉ sử dụng một hàng đợi lệnh duy nhất (single queue) với độ sâu tối đa là 32 lệnh. Quan trọng hơn, kiến trúc này yêu cầu cơ chế khóa đồng bộ (synchronization lock) khi phát hành lệnh, tạo ra nút thắt cổ chai cực lớn trên các CPU đa nhân.

- Chuẩn NVMe: Phá vỡ hoàn toàn giới hạn này bằng cách hỗ trợ lên đến 65.535 Hàng đợi I/O (I/O Queues). Trên các máy chủ hiện đại, hệ điều hành có thể gán riêng một cặp hàng đợi I/O cho từng nhân CPU hoặc từng luồng (thread). Điều này loại bỏ hoàn toàn cơ chế khóa tranh chấp (lock contention), cho phép xử lý I/O song song thực sự.

Giải mã bí ẩn: Tại sao kích thước 65.536 slots nhưng chỉ chứa được 65.535 lệnh?

Nếu bạn đọc kỹ NVM Express Base Specification Revision 2.1, bạn sẽ thấy một chi tiết kỹ thuật cực kỳ thú vị: Kích thước vật lý tối đa của mỗi hàng đợi I/O là 65.536 vị trí (slots). Tuy nhiên, số lượng lệnh chờ xử lý tối đa (outstanding commands) chỉ là 65.535. Tại sao lại mất đi 1 slot?

Câu trả lời nằm ở thuật toán Bộ đệm vòng (Circular Buffer). NVMe quản lý hàng đợi bằng hai con trỏ:

- Con trỏ Tail (Producer): Trỏ đến vị trí trống tiếp theo để máy chủ đẩy lệnh vào.

- Con trỏ Head (Consumer): Trỏ đến vị trí lệnh tiếp theo mà bộ điều khiển NVMe cần lấy ra xử lý.

Khi hàng đợi rỗng, Head == Tail. Tuy nhiên, nếu NVMe cho phép lấp đầy toàn bộ 65.536 slots, con trỏ Tail sau khi chạy hết một vòng sẽ cuộn lại (wrap around) và nằm đè lên chính con trỏ Head (Tail == Head). Lúc này, ở cấp độ logic phần cứng, hệ thống sẽ mất khả năng nhận diện, nó không thể phân biệt được hàng đợi đang hoàn toàn rỗng hay đang đầy 100%.

Để giải quyết giới hạn toán học này, đặc tả NVMe bắt buộc phải hy sinh 1 slot làm mốc chặn. Trạng thái Đầy được định nghĩa là khi Head == Tail + 1. Sự tinh tế trong thiết kế này giúp hệ thống duy trì 65.535 lệnh chờ song song trên mỗi hàng đợi một cách ổn định nhất.

Giao thức NVMe giải quyết triệt để nút thắt xử lý đa luồng nhờ khả năng phân bổ 65.535 hàng đợi lệnh song song.

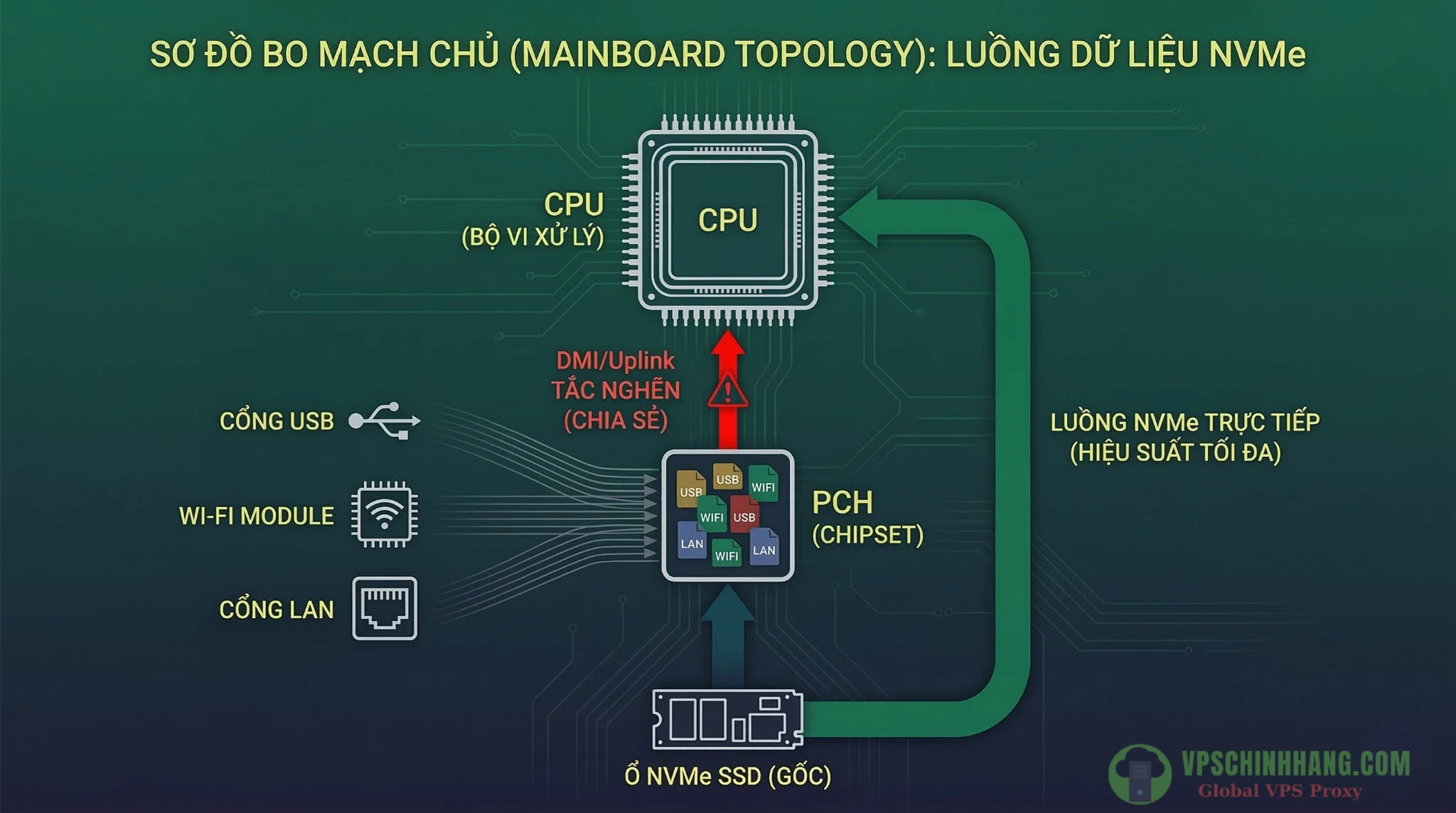

Nút thắt cổ chai CPU và cấp phát làn PCIe (PCIe lane allocation)

Có bao giờ bạn thắc mắc tại sao VPS NVMe lại giúp hệ thống chạy mượt hơn, dù bạn không đụng chạm gì đến code?

NVMe giải phóng 33% tài nguyên CPU

Theo Seagate – Non-Volatile Memory Express optimizes system’s devices, NVMe giúp giảm mức sử dụng tài nguyên CPU xuống khoảng 33% so với chuẩn AHCI. Lý do là NVMe loại bỏ hoàn toàn khâu biên dịch giao thức trung gian SCSI/SATA.

Một tác vụ I/O trên AHCI phải đi qua hàng loạt tầng driver và tiêu tốn đến 27.000 chu kỳ CPU (CPU cycles). Trong khi đó, tác vụ tương tự đi trực tiếp qua bus PCIe của NVMe chỉ tốn khoảng 10.000 chu kỳ. Việc tiết kiệm chu kỳ CPU này giúp giảm đáng kể thời gian I/O wait, nhường sức mạnh xử lý cho các logic nghiệp vụ của ứng dụng.

Cạm bẫy PCIe lane allocation

Bạn thuê một con VPS NVMe Gen4 nhưng tốc độ benchmark lại lẹt đẹt? Nút thắt có thể nằm ở kiến trúc máy chủ vật lý của nhà cung cấp, cụ thể là PCIe Lane Allocation.

- CPU-Connected Lanes: Nếu ổ NVMe được cắm trực tiếp vào làn PCIe của CPU, nó tận hưởng băng thông tối đa và độ trễ thấp nhất.

- Chipset-Connected Lanes: Nếu ổ NVMe cắm qua khe phụ đi vòng qua Chipset, luồng dữ liệu sẽ gặp thảm họa. Chipset chỉ kết nối với CPU qua một đường Uplink duy nhất (thường giới hạn ở PCIe x4). Đường Uplink này phải gánh chung băng thông cho mạng LAN, Wi-Fi, USB và các ổ cứng khác. Khi hệ thống có tải hỗn hợp, các thiết bị sẽ cạnh tranh băng thông ngược (upstream bandwidth), khiến ổ NVMe của bạn bị sụt tốc độ nghiêm trọng.

Ổ NVMe cắm qua Chipset sẽ bị chia sẻ băng thông Uplink với các thiết bị khác, làm giảm tốc độ thực tế của máy chủ.

Tổng hợp Bảng so sánh Kiến trúc: AHCI/SATA vs NVMe/PCIe

Trước khi đi vào các con số đo lường tốc độ, hãy cùng nhìn lại bức tranh tổng thể về mặt kiến trúc. Bảng dưới đây tóm tắt lý do tại sao NVMe không chỉ đơn thuần là SATA chạy nhanh hơn, mà là một sự tiến hóa hoàn toàn về mặt cấu trúc hạ tầng.

| Tiêu chí Kiến trúc | Giao thức AHCI (VPS SSD SATA) | Giao thức NVMe (VPS NVMe) | Tác động thực tiễn đến máy chủ |

| Giao diện vật lý | Cổng SATA (Tối ưu cho ổ đĩa quay HDD) | Bus PCIe (Tối ưu riêng cho bộ nhớ Flash) | Băng thông truyền tải dữ liệu của NVMe lớn hơn gấp nhiều lần. |

| Độ sâu hàng đợi (Queues) | 1 hàng đợi duy nhất | Lên đến 65.535 hàng đợi I/O | NVMe cho phép phân luồng dữ liệu độc lập cho từng nhân vCPU. |

| Lệnh chờ tối đa / Hàng đợi | 32 lệnh | 65.535 lệnh chờ xử lý | Ngăn chặn hiện tượng nghẽn cổ chai khi website có hàng ngàn traffic truy cập cùng lúc. |

| Chu kỳ xử lý CPU (CPU Cycles) | ~ 27.000 chu kỳ cho mỗi tác vụ I/O | ~ 10.000 chu kỳ cho mỗi tác vụ I/O | NVMe tiết kiệm 33% tài nguyên CPU, giảm thiểu tình trạng I/O wait (cột wa trên htop). |

| Cơ chế khóa đồng bộ | Bắt buộc (Gây độ trễ do phải chờ cấp quyền) | Không yêu cầu (Xử lý song song độc lập) | NVMe loại bỏ hàng xóm ồn ào (noisy neighbor) trong môi trường ảo hóa dùng chung. |

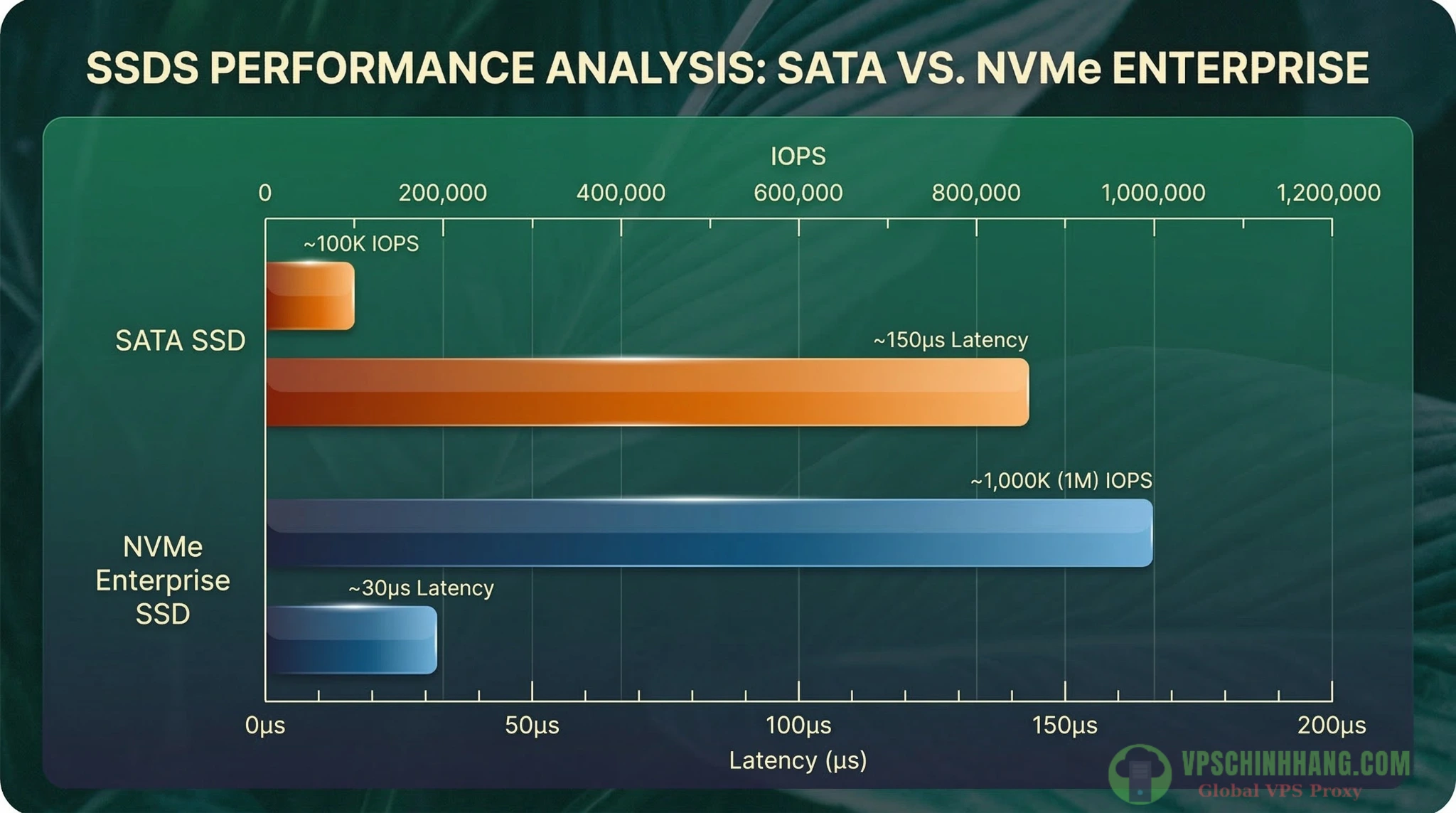

So sánh benchmark thực tế: Xóa bỏ thông số ảo

Để chứng minh sức mạnh, chúng ta hãy so sánh thông số thực tế từ các dòng ổ cứng Data Center/Enterprise như Micron 7450 (PCIe Gen4) và Kingston DC1500M (PCIe Gen3) so với SSD SATA cấp doanh nghiệp.

Tốc độ tuần tự và IOPS ngẫu nhiên

- SSD SATA Enterprise: Đọc/Ghi tuần tự kịch trần ở mức ~550 MB/s. IOPS ngẫu nhiên (4K) thường chỉ dao động từ 80.000 – 100.000 IOPS.

- NVMe Enterprise: Tốc độ đọc tuần tự của Micron 7450 lên tới 6.800 MB/s (gấp 12 lần SATA). Đáng sợ hơn, IOPS đọc ngẫu nhiên đạt ngưỡng 1.000.000 IOPS.

Đối với Database và Web server, dữ liệu không nằm ở dạng file lớn mà rải rác thành hàng chục ngàn block 4KB nhỏ lẻ. Chỉ số IOPS khổng lồ của NVMe đảm bảo CPU luôn được cung cấp đủ dữ liệu để xử lý mà không phải đợi.

Độ trễ (Latency): Bài toán cộng dồn chí mạng

Nhiều người cho rằng chênh lệch độ trễ vài phần nghìn giây (ms) là vô nghĩa. Đó là tư duy sai lầm trong thiết kế hệ thống.

- Độ trễ của SSD SATA Enterprise thường ở mức 120 µs (đọc) và 180 µs (ghi), và có thể kéo dài lên hàng chục mili-giây khi tải nặng.

- Độ trễ điển hình của NVMe Micron 7450 chỉ ở mức 80 µs (đọc) và cực thấp 15 µs (ghi).

Hãy làm một phép toán: Khi user click nút Thanh toán, backend có thể trigger 80 truy vấn nhỏ lẻ xuống Database (check tồn kho, xác thực user, tính mã giảm giá).

- Với SSD SATA (giả sử trễ trung bình 0.5ms khi có tải): 80 x 0.5ms = 40ms delay I/O thuần túy.

- Với NVMe (giả sử trễ 0.1ms): 80 x 0.1ms = 8ms delay.

Sự cộng dồn độ trễ 32ms ở tầng Storage tưởng chừng nhỏ bé này lại chính là chìa khóa để giảm TTFB (Time To First Byte). Trong các đợt Flash Sale có hàng ngàn user thao tác cùng lúc, độ trễ cộng dồn của SATA sẽ gây nghẽn hàng đợi (queue blocking) làm gián đoạn dịch vụ, trong khi NVMe vẫn hoạt động ổn định.

Chênh lệch hiệu năng I/O ngẫu nhiên và độ trễ thực tế giữa các dòng ổ cứng Enterprise chuẩn SATA và NVMe.

Góc thực chiến: Tại sao lệnh dd là không hiệu quả khi test NVMe?

Rất nhiều sysadmin khi nhận bàn giao VPS NVMe thường gõ ngay lệnh dd (dd if=/dev/zero...) để test tốc độ và thất vọng khi kết quả không như ý.

Theo khuyến cáo từ AWS re:Post – Instance store performance, lệnh dd chỉ hoạt động theo cơ chế đơn luồng (single-threaded) và xử lý tuần tự (queue depth = 1). Dùng dd để test NVMe giống như việc bạn cầm lái một chiếc xe đua F1 nhưng lại chỉ chạy ở số 1. Nó không thể đánh thức được khả năng xử lý song song của hàng chục ngàn I/O queues.

Để đo lường chính xác IOPS thực tế, bạn bắt buộc phải dùng fio (Flexible I/O Tester).

fio --randrepeat=1 --ioengine=libaio --direct=1 --gtod_reduce=1 \

--name=test_nvme --filename=test_nvme.fio --bs=4k --iodepth=64 \

--size=4G --readwrite=randread --numjobs=4

Các tham số cấu hình như --iodepth=64 (đẩy nhiều lệnh vào hàng đợi cùng lúc) và --numjobs=4 (mô phỏng chạy đa luồng) sẽ ép hệ thống nhồi lệnh vào các I/O Queues của NVMe, đẩy storage đến giới hạn tối đa (stress test) để hiển thị con số IOPS thực sự.

Khi nào dự án của bạn bắt buộc phải lên VPS NVMe?

Đầu tư nâng cấp hạ tầng luôn đi kèm với chi phí. Nếu bạn chỉ vận hành một blog tĩnh vài trăm traffic/ngày, SSD SATA vẫn làm tốt nhiệm vụ. Nhưng hệ thống của bạn sẽ bắt buộc phải sử dụng NVMe nếu rơi vào các workload sau:

- Cơ sở dữ liệu (OLTP) & Xử lý giao dịch: MySQL, PostgreSQL, MongoDB với dữ liệu phình to hàng chục GB. Các lệnh

JOINphức tạp hay Table Scan sẽ vắt kiệt I/O. NVMe giải quyết triệt để các slow query do đĩa. - Ảo hóa mật độ cao (Virtualization): NVMe cho phép Hypervisor gán các hàng đợi dữ liệu chuyên dụng cho từng vCPU. Điều này giúp loại bỏ triệt để hiện tượng hàng xóm ồn ào (noisy neighbor), nơi một máy ảo tải nặng làm chậm toàn bộ node.

- Trí tuệ nhân tạo (AI), Machine Learning & HPC: Cần luân chuyển các tập dataset khổng lồ (multi-gigabyte) mỗi giây vào bộ nhớ GPU. Nếu dùng SATA, thiết bị lưu trữ sẽ thành nút thắt khiến dàn GPU đắt tiền bị nhàn rỗi.

- Website Thương mại điện tử tải nặng: Các truy vấn động (Dynamic requests) vào giỏ hàng và thanh toán không thể cache. Kiến trúc queue song song của NVMe đảm bảo user không gặp lỗi 503 khi thực hiện thanh toán.

- Môi trường DevOps (CI/CD): Tác vụ build Docker image hay compile mã nguồn yêu cầu đọc/ghi hàng ngàn file nhỏ liên tục. NVMe rút ngắn thời gian chạy CI/CD pipeline từ vài chục phút xuống còn vài phút.

Câu hỏi thường gặp (FAQ)

1. VPS NVMe có đắt hơn VPS SSD nhiều không?

Chỉ nhỉnh hơn khoảng 15-30%. Đổi lại, bạn nhận được IOPS gấp 10 lần và độ trễ giảm 5 lần. Đây là khoản đầu tư (ROI) cực kỳ xứng đáng để tối ưu hiệu suất hệ thống.

2. Làm sao để check VPS tôi thuê có đúng là NVMe thật không?

Gõ lệnh lsblk hoặc nvme list trên terminal Linux. Nếu thấy tên phân vùng có dạng nvme0n1 và test IOPS bằng lệnh fio ra chỉ số hàng trăm ngàn, đó là cấu hình chuẩn.

3. Website WordPress có bắt buộc phải dùng VPS NVMe không?

Không cần nếu chỉ là blog tĩnh có cache. Nhưng BẮT BUỘC nếu web chạy WooCommerce, LearnDash, diễn đàn hoặc có lượng người dùng tương tác realtime liên tục để tránh nghẽn Database.

4. Dữ liệu trên VPS NVMe có dễ bị mất không?

Phụ thuộc vào kiến trúc. Local NVMe (cắm trực tiếp) xử lý nhanh nhưng có rủi ro về mặt dữ liệu nếu node vật lý sập. NVMe-oF (EBS/Network Storage) thì an toàn hơn. Luôn ưu tiên gói dịch vụ có Backup tự động.

Kết luận

Công nghệ lưu trữ đã chính thức bước sang một kỷ nguyên mới. Giao thức NVMe không đơn thuần chỉ là một chuẩn cắm phần cứng; nó là sự đập đi xây lại toàn bộ kiến trúc giao tiếp I/O nhằm giải phóng sức mạnh của hệ thống bộ nhớ Flash, loại bỏ những giới hạn của AHCI.

Khi hiệu năng I/O trở thành rào cản ngăn cản ứng dụng của bạn scale-up, việc chuyển đổi sang VPS NVMe là một khoản đầu tư mang tính chiến lược. Nút thắt ở đâu, ta gỡ ở đó. Việc nâng cấp vCPU hay RAM sẽ không mang lại hiệu quả cao nếu dữ liệu của bạn vẫn đang bị nghẽn ở cổng kết nối ổ cứng.

Tài liệu tham khảo

- NVM Express Base Specification Revision 2.1 2024.08.05 Ratified | PDF

- Tech Brief: NVMe—Performance for the SSD Age >

- Micron® 7450 SSD with NVMe™ Product Brief

- PCIe Lane Allocation: Why Your SSD Isn’t Always Running at Full Speed –

- Benchmarking Local SSD performance | Compute Engine | Google Cloud Documentation