Cấu hình HAProxy Load Balancer phân tải cho cụm VPS Linux (2026)

Nửa đêm, hệ thống monitoring báo alert. Server ngừng hoạt động cục bộ vì một chiến dịch flash sale đẩy traffic lên gấp hàng chục lần bình thường. Chiếc VPS duy nhất đang chạy ứng dụng không gánh nổi lượng request khổng lồ, CPU chạm đỉnh 100%, OOM (Out of Memory) Killer của Linux bắt đầu loại bỏ các process quan trọng ra khỏi RAM, database bị lock, và kết quả là người dùng bị ngắt kết nối, từ chối request hàng loạt.

Đây là vấn đề kinh điển mà bất kỳ System Engineer hay DevOps nào cũng từng nếm trải khi hạ tầng gặp thắt cổ chai (bottleneck). Khi phần cứng vật lý đã đạt giới hạn, giải pháp cốt lõi là chia nhỏ áp lực ra nhiều node khác nhau (scale-out). Và để điều phối hàng chục nghìn kết nối một cách mượt mà, việc cấu hình HAProxy Load Balancer chính là giải pháp quan trọng cứu toàn bộ hệ thống.

Từ việc tinh chỉnh lõi Linux, loại bỏ server ngừng hoạt động, cho đến thao tác reload cấu hình không mất một gói tin nào, bài viết này sẽ trình bày chi tiết toàn bộ phương pháp vận hành chuẩn Enterprise. Bạn đã sẵn sàng nâng cấp hạ tầng của mình chưa?

Vấn đề mất request, quá tải server và bài toán scale hạ tầng của DevOps

Bất kỳ hệ thống web application nào khi mới khởi chạy cũng thường bắt đầu với mô hình All-in-One: Web server, Database, Caching nằm chung trên một chiếc VPS. Mô hình này chạy rất mượt cho đến khi user base tăng đột biến. Chỉ cần một API call xử lý chậm hoặc một đợt traffic spike đổ về, toàn bộ server sẽ bị treo cứng.

Lúc này, developer bắt buộc phải mở rộng theo chiều ngang (Horizontal Scaling) bằng cách nhân bản mã nguồn ra nhiều VPS Backend khác nhau. Tuy nhiên, khi có 5 hay 10 con VPS cùng chạy một mã nguồn, người dùng sẽ truy cập vào IP nào?

Đó chính là lúc Load Balancer (Bộ cân bằng tải) xuất hiện, đóng vai trò như một điều phối viên giao thông, đứng trước cụm VPS và điều hướng request của user vào những server đang rảnh rỗi nhất. Nếu một server đột ngột mất kết nối, Load Balancer sẽ lập tức nhận biết và ngừng gửi traffic vào đó, đảm bảo trải nghiệm người dùng không bị gián đoạn.

Sự khác biệt giữa mô hình máy chủ đơn lẻ (dễ quá tải) và mô hình phân tán (Scale-out) thông minh sử dụng HAProxy.

Tại sao HAProxy lại được lòng các doanh nghiệp lớn như GitHub?

Trong thế giới mã nguồn mở, Nginx và HAProxy được định nghĩa là một giải pháp reverse-proxy toàn diện, cung cấp đồng thời tính sẵn sàng cao (High Availability), cân bằng tải (Load Balancing) và proxy cho các ứng dụng dựa trên TCP và HTTP.

Chính nhờ kiến trúc hướng sự kiện (event-driven) linh hoạt và xử lý đa luồng nhẹ (light multi-threading), HAProxy có khả năng mở rộng quy mô cực tốt. Các báo cáo hiệu năng thực tế đã chứng minh nó có thể xử lý tối đa 2 triệu requests/giây qua kết nối SSL cùng băng thông chuyển tiếp dữ liệu đạt mức 100 Gbps.

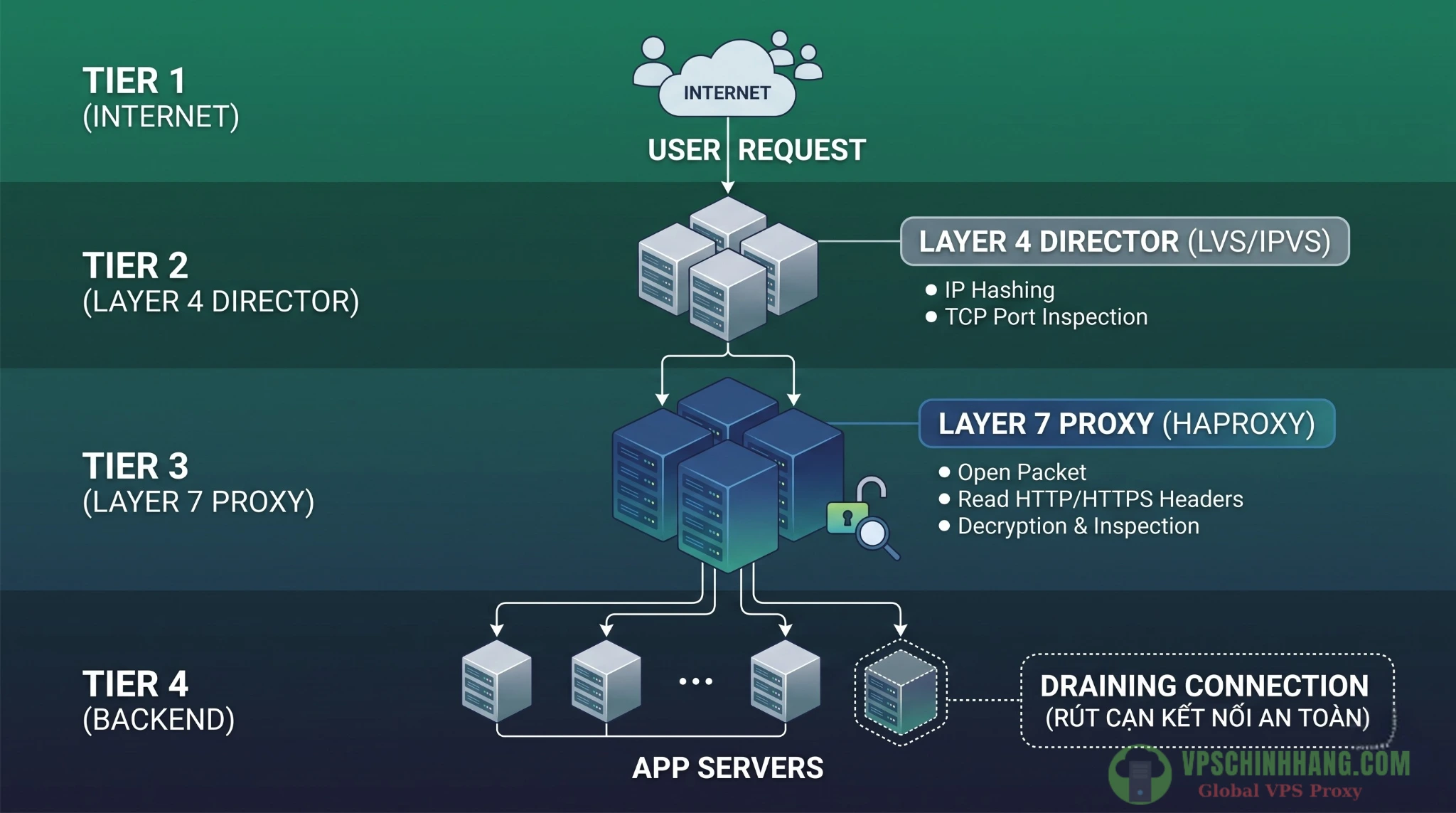

Sức mạnh của kiến trúc phân tách Layer 4 vs Layer 7 (GitHub Case Study)

Để gánh lượng traffic khổng lồ (hơn 5 tỷ request mỗi ngày), GitHub không dùng một cấu hình Load Balancer nguyên khối. Họ phân tách rạch ròi thành hai lớp để khắc phục nhược điểm của DNS cache và đảm bảo duy trì kết nối:

- Lớp Layer 4 (Director tier – Điều hướng): Lớp này nhận lưu lượng qua giao thức ECMP và hoạt động hoàn toàn không lưu trạng thái (stateless). Khi nhận gói tin TCP, nó băm (hash) IP nguồn để chọn máy chủ Proxy phù hợp, sau đó đóng gói (encapsulate) vào gói tin UDP và gửi đi. Việc này giúp họ mở rộng một IP Public cho vô số máy chủ vật lý phía sau.

- Lớp Layer 7 (Proxy tier – Xử lý ứng dụng): Chạy phần mềm HAProxy. Lớp này nhận gói UDP, mở gói lấy TCP gốc và xử lý. Khi phản hồi, nó dùng cơ chế Direct Server Return (DSR) trả dữ liệu thẳng về client mà không cần đi vòng ngược qua Director.

- Tối thượng về bảo trì: Nhờ sự phân lớp này, GitHub có thể từ từ loại bỏ dần (graceful draining) các kết nối trên máy chủ Proxy L7 cần bảo trì mà không làm đứt gãy kết nối TCP của người dùng. Lớp L4 vẫn sẽ đảm bảo các request hiện tại được trỏ về đúng máy chủ Proxy cũ cho đến khi hoàn thành.

Kiến trúc phân lớp L4/L7 giúp Github xử lý hàng tỷ request mỗi ngày mà không làm đứt gãy kết nối khi bảo trì.

Chuẩn bị & tối ưu lõi Linux trước khi cấu hình HAProxy Load Balancer

Khoan hãy vội gõ lệnh cài đặt HAProxy. Rất nhiều người cấu hình maxconn trong HAProxy lên hàng chục nghìn, nhưng lại quên mất giới hạn của chính hệ điều hành Linux. Dù HAProxy có hiệu năng cao đến đâu, nếu nhân (Kernel) Linux chặn lại thì hệ thống vẫn nghẽn.

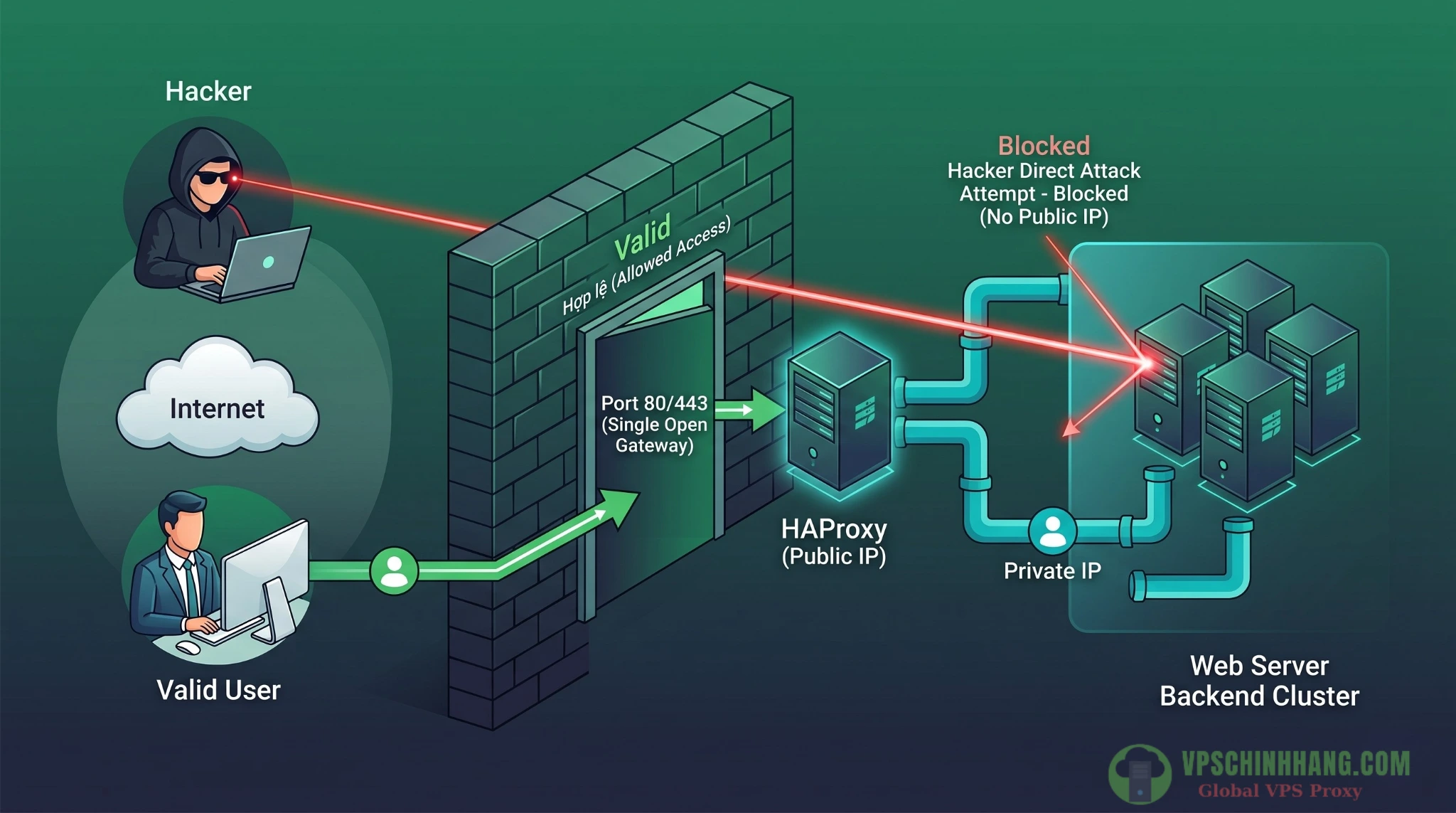

Quy hoạch mạng nội bộ (Private Network) và Firewall

Cấu hình tường lửa là lớp khiên đầu tiên:

- Node HAProxy (Frontend): Cần có IP Public. Mở Port 80 (HTTP) và 443 (HTTPS) trên Firewall để đón người dùng. Mở thêm giao thức VRRP (Protocol 112) nếu bạn có chạy cụm dự phòng Keepalived.

- Cụm Node Backend (Web/App): Tuyệt đối đóng tất cả kết nối từ Internet (Public IP). Tường lửa hoặc Web Server (Nginx/Apache) trên backend chỉ được mở port dịch vụ (ví dụ 80, 8080) cho duy nhất dải Private IP của máy chủ HAProxy. Bất cứ request nào đánh thẳng vào IP Public của Backend đều phải bị drop.

Tối ưu bảo mật bằng cách đóng toàn bộ Port Public của Backend, chỉ cho phép giao tiếp với HAProxy qua dải Private IP.

Tinh chỉnh Kernel Linux (sysctl) để chống nghẽn cổ chai

Mở file sysctl bằng lệnh sudo nano /etc/sysctl.conf và áp dụng các thông số tối ưu sức mạnh mạng:

# 1. Tăng tối đa số lượng file descriptors (tệp mở) của toàn hệ thống

# Mỗi socket mạng là một file descriptor. Mở rộng để tránh lỗi "Too many open files".

fs.file-max = 100000

# 2. Mở rộng dải cổng phù du (ephemeral ports)

# Giúp HAProxy có đủ cổng để khởi tạo kết nối liên tục đến các máy chủ backend (tránh port exhaustion).

net.ipv4.ip_local_port_range = 10000 65000

# 3. Kích thước tối đa của hàng đợi TCP listen backlog

# Giúp hệ thống hấp thụ tốt các đợt tăng vọt traffic đột ngột hoặc SYN flood.

net.core.somaxconn = 2048

# 4. Cho phép tái sử dụng nhanh các socket đang ở trạng thái TIME_WAIT

net.ipv4.tcp_tw_reuse = 1Lưu ý: Sau khi lưu file, chạy lệnh sudo sysctl -p để áp dụng ngay. Với các máy chủ RHEL/Ubuntu mới, bạn có thể cân nhắc đẩy somaxconn lên 65535 nếu RAM thực sự dồi dào.

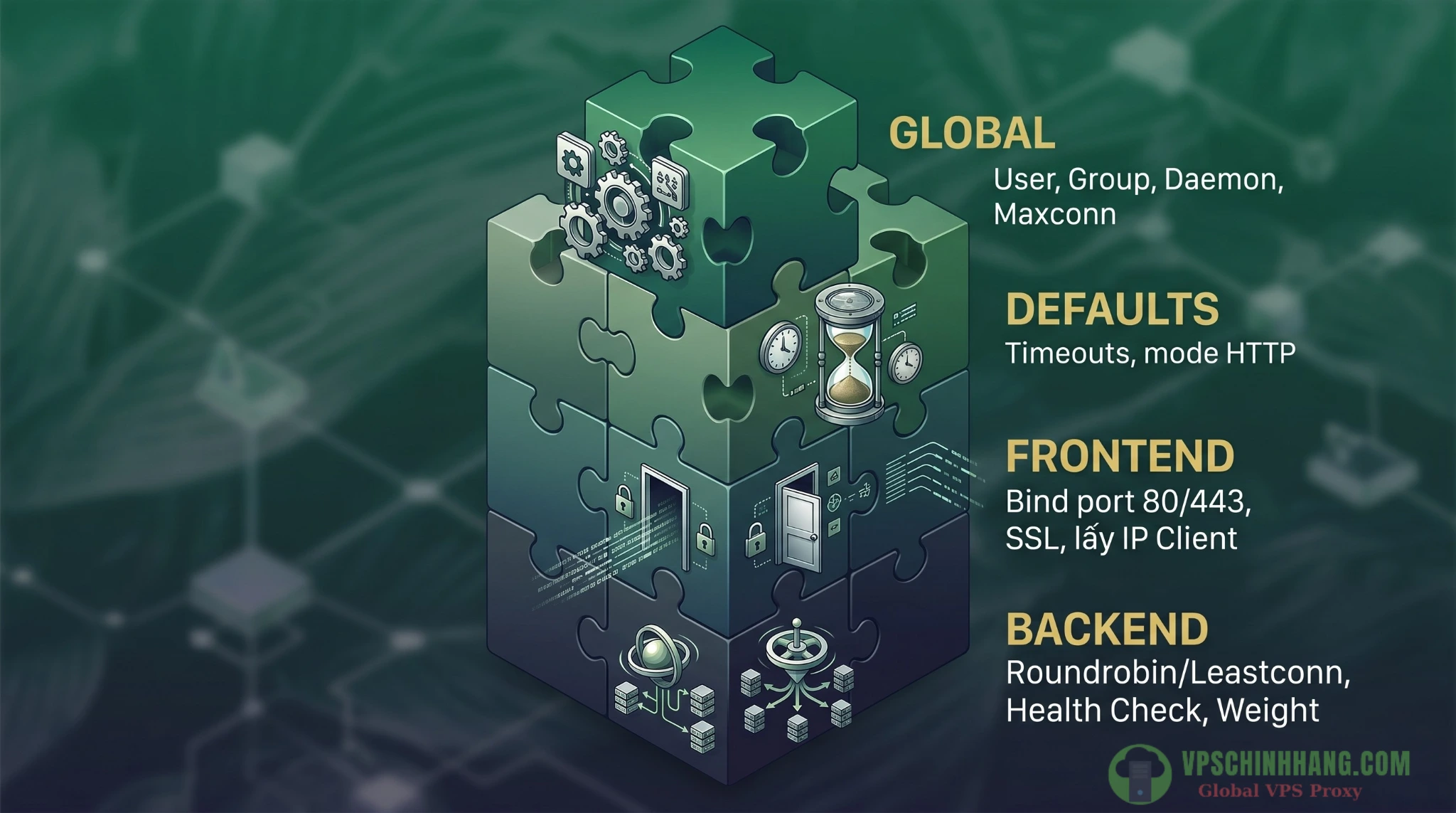

4 bước cấu hình HAProxy Load Balancer cốt lõi từ A-Z

Chúng ta sẽ can thiệp vào file cấu hình sinh tử /etc/haproxy/haproxy.cfg. Luôn nhớ nguyên tắc số 1 của DevOps: Backup file này trước khi chỉnh sửa bất cứ thứ gì.

Bước 1: Cài đặt package bản mới nhất và backup config

Sử dụng kho PPA chuẩn của cộng đồng để cài đặt bản mới nhất (ví dụ nhánh 3.x) thay vì bản cũ trong repo mặc định của Ubuntu/Debian:

Cập nhật danh sách gói và cài đặt các công cụ hỗ trợ:

sudo apt update && sudo apt install software-properties-common -yThêm kho lưu trữ PPA của HAProxy:

sudo add-apt-repository ppa:vbernat/haproxy-3.3 -yCập nhật lại danh sách gói và cài đặt HAProxy:

sudo apt update && sudo apt install haproxy -ySau khi cài đặt xong, hãy tạo ngay một bản sao lưu (backup) cho file cấu hình gốc để có đường lùi nếu lỡ tay làm hỏng:

sudo cp /etc/haproxy/haproxy.cfg /etc/haproxy/haproxy.cfg.bakBước 2: Tinh chỉnh block global, defaults và sự thật về maxconn

Mở file cấu hình bằng text editor:

sudo nano /etc/haproxy/haproxy.cfgFile cấu hình chia làm các block chính: global, defaults, frontend, và backend.

Sự thật về biến maxconn (Maximum Connections): Theo tài liệu cấu hình chính thức, nếu bạn không khai báo maxconn trong block global, hệ thống sẽ tự động tính toán số lượng kết nối tối đa dựa trên giới hạn file descriptor của Linux (kiểm tra qua lệnh ulimit -nH) lúc khởi động.

Tuy nhiên, bắt buộc phải set cứng maxconn minh bạch trên môi trường Production bởi vì: Mỗi kết nối TCP thiết lập thành công trên HAProxy tiêu tốn khoảng 33 KB RAM. Nếu để OS cấp phát tự do, HAProxy có thể cố gắng phục vụ số lượng request vượt xa dung lượng RAM vật lý, dẫn tới cạn kiệt RAM (Memory Exhaustion) và Crash hệ thống. Khi bạn set một ngưỡng maxconn cụ thể, các kết nối dôi dư sẽ được xếp vào hàng đợi (listen queue) một cách an toàn thay vì gây lỗi.

global

log /dev/log local0

user haproxy

group haproxy

daemon

# Giới hạn an toàn, cần tính toán dựa trên tổng RAM máy chủ

maxconn 25000

defaults

log global

mode http

option httplog

timeout connect 5s

timeout client 50s

timeout server 50sBước 3: Định tuyến thông minh với frontend và backend

Xóa các cấu hình demo cũ bên dưới block defaults và thêm vào luồng traffic thực tế của bạn:

# Lắng nghe traffic từ người dùng

frontend http_front

bind *:80

default_backend web_backends

# Định nghĩa cụm server xử lý

backend web_backends

balance roundrobin

server web1 10.0.0.10:80 check

server web2 10.0.0.11:80 check

4 khối lệnh cốt lõi tạo nên “linh hồn” định tuyến của toàn bộ hệ thống HAProxy.

Bước 4: Check syntax và kỹ thuật Hitless Reload (không mất request)

Tuyệt đối không dùng lệnh systemctl restart haproxy. Lệnh restart (hoặc stop) hoạt động theo cơ chế hard stop bằng cách gửi tín hiệu SIGTERM. Tiến trình HAProxy sẽ ngừng hoạt động đột ngột và đóng cưỡng bức toàn bộ các luồng kết nối đang truyền tải, gây gián đoạn dịch vụ (outage).

Thay vào đó, hãy làm theo quy trình chuẩn:

- Check syntax:

haproxy -c -V -f /etc/haproxy/haproxy.cfg. Cờ-V(Verbose) sẽ in ra xác nhận chi tiết nếu cấu hình hợp lệ. - Hitless Reload (Dừng mềm):

systemctl reload haproxy. Lệnh này (hoạt động hoàn hảo nếu chạy Master-Worker mode với tín hiệuSIGUSR2) sẽ yêu cầu HAProxy sinh ra các process worker mới để nhận request mới. Các process cũ vẫn tiếp tục duy trì để phục vụ nốt các request đang dang dở cho đến khi hoàn thành mới tự thoát.

Thuật toán phân tải & cấu hình Health Check chuẩn Production

Roundrobin vs Leastconn: Chọn thuật toán nào?

Trong block backend, chúng ta khai báo thuật toán qua từ khóa balance:

balance roundrobin(Xoay vòng): Các máy chủ nhận request lần lượt theo vòng luân phiên. Cực mượt cho tải đều, nhưng bị giới hạn thiết kế tối đa 4095 máy chủ trên một backend.balance leastconn(Ít kết nối nhất): Đẩy request vào máy chủ đang có số lượng kết nối (tính cả queue) thấp nhất để tránh thắt cổ chai. Tài liệu chính thức chỉ định thuật toán này cho các hệ thống có phiên kết nối kéo dài (very long sessions) như SQL database, LDAP. Không nên dùng cho traffic HTTP ngắn.

Tối ưu máy chủ lệch cấu hình bằng tham số weight: Nhiều người lầm tưởng weight là một thuật toán. Thực chất nó là một tham số máy chủ (server parameter). Nếu bạn có 1 server mạnh gánh tải gấp 4 lần server yếu, hãy cấu hình tỉ lệ 40:10.

backend web_backends

balance roundrobin

server server_manh 10.0.0.10:80 check weight 40

server server_yeu 10.0.0.11:80 check weight 10Health Check HTTP: Đừng để server ngừng hoạt động vẫn nhận traffic

Nếu bạn chỉ để từ khóa check ở cuối dòng khai báo server, HAProxy mặc định chỉ kiểm tra sức khỏe ở Layer 4 (TCP). Nghĩa là, chỉ cần Web Server trả về gói tin SYN/ACK trên port 80, nó được coi là đang hoạt động. Lỗ hổng ở đây là nếu Database bị mất kết nối, app trả về toàn mã lỗi HTTP 500, HAProxy vẫn không biết và tiếp tục điều hướng user vào máy chủ lỗi đó.

Bạn phải nâng cấp lên Layer 7 HTTP Check:

backend web_backends

balance roundrobin

option httpchk

http-check send meth GET uri /healthz

http-check expect status 200

server web1 10.0.0.10:80 check(Lưu ý: Bạn phải lập trình endpoint /healthz trên mã nguồn ứng dụng sao cho nó chỉ trả về HTTP Code 200 OK khi đã kết nối Database/Redis thành công).

3 cấu hình nâng cao (Advanced) bắt buộc phải biết

Ghi nhận IP thật của client với option forwardfor

Vì HAProxy là reverse-proxy, server backend sẽ chỉ nhìn thấy IP của con HAProxy. Điều này làm hỏng logic giới hạn rate-limit IP hay log truy cập của bạn. Để giải quyết, hãy yêu cầu HAProxy chèn IP thật của người dùng vào HTTP Header:

defaults

# Chèn IP thật vào header X-Forwarded-For, bỏ qua traffic từ localhost

option forwardfor except 127.0.0.1Bên phía Nginx/Apache, bạn chỉ cần cấu hình đọc IP từ header X-Forwarded-For.

Cấu hình SSL Termination đúng chuẩn (gộp file .pem)

Giải mã HTTPS là tác vụ ngốn CPU. Hãy giao việc đó cho HAProxy xử lý tại tầng biên (Edge) bằng SSL Termination. Theo tài liệu HAProxy, bạn cần chuẩn bị một file .pem chứa toàn bộ chuỗi bảo mật. Cấu trúc gộp chuẩn là: Khóa bí mật (Private Key) + Chứng chỉ máy chủ (Certificate) + Các chứng chỉ trung gian (Intermediate CA).

Thực hiện lệnh gộp file chứng chỉ trên Linux:

cat private.key cert.crt intermediate.crt > combined.pemSau đó khai báo frontend lắng nghe port 443:

frontend https_front

bind *:443 ssl crt /etc/ssl/certs/combined.pem

default_backend web_backendsBật Stats Dashboard để monitor hệ thống real-time

Tạo một block listen độc lập để mở giao diện thống kê trạng thái server. Hãy nhớ giấu phiên bản HAProxy để tránh dò tìm lỗ hổng:

listen stats

bind *:8404

mode http

stats enable

stats hide-version

stats uri /stats

stats realm HAProxy\ Statistics

stats auth devops:MatKhauSieuKho123!

stats refresh 5sTruy cập http://IP_HAProxy:8404/stats và đăng nhập, bạn sẽ thấy toàn cảnh traffic, lượng request/s, và trạng thái UP/DOWN real-time của backend.

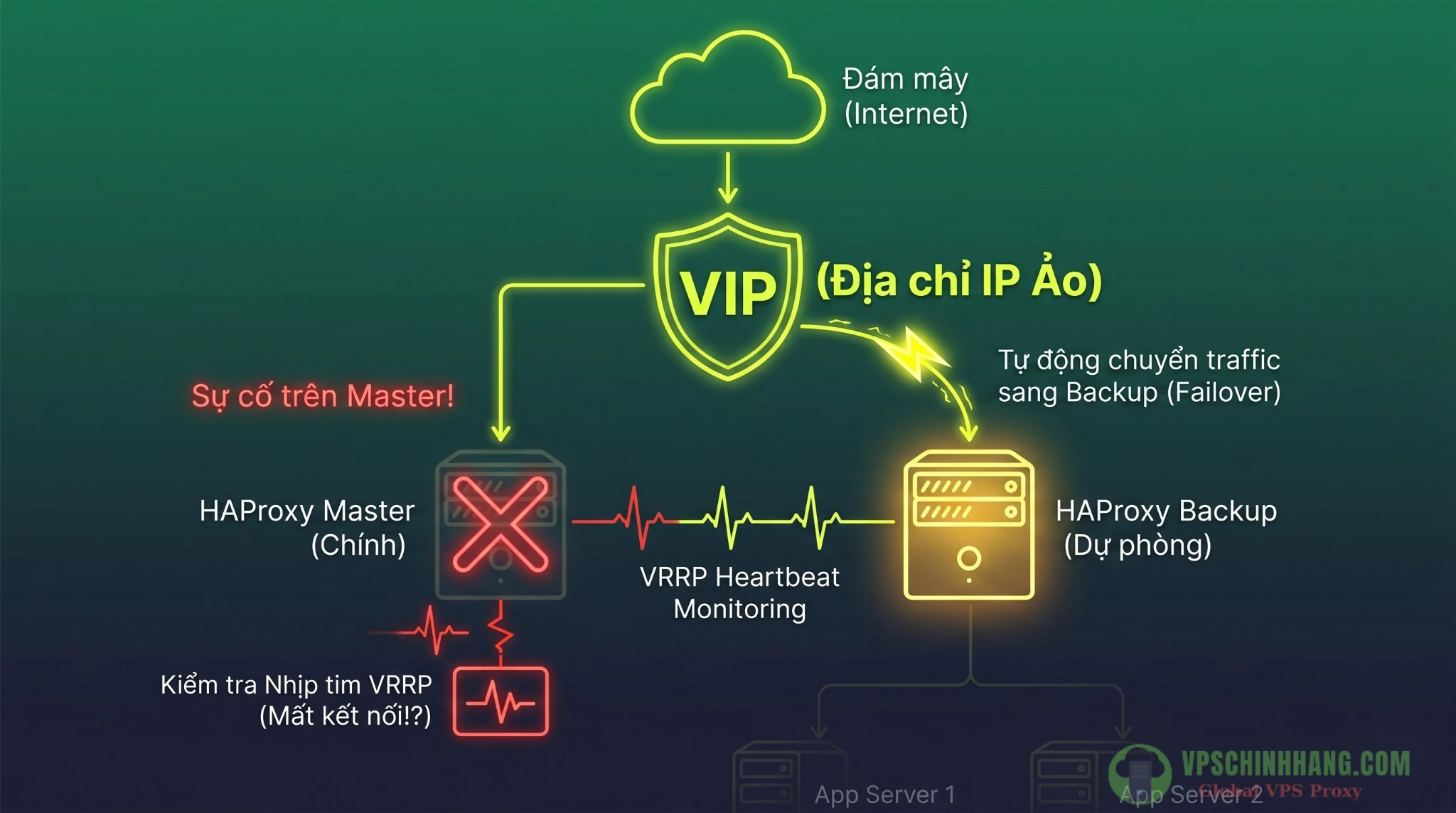

Xóa bỏ điểm lỗi duy nhất (SPOF): Kết hợp Keepalived tạo cụm High Availability

Nếu bạn đã cấu hình HAProxy Load Balancer hoàn hảo, nhưng bản thân con máy chủ chạy HAProxy đó bị mất mạng hoặc đứt cáp thì sao? Toàn bộ backend sẽ không thể truy cập vì đây chính là Điểm lỗi duy nhất (Single Point of Failure – SPOF).

Kiến trúc chuẩn Enterprise bắt buộc phải kết hợp HAProxy với Keepalived để tạo cụm High Availability (HA).

- Bạn chạy 2 node HAProxy (Master và Backup). Cài Keepalived lên cả hai.

- Keepalived sẽ sinh ra một địa chỉ IP ảo (Virtual IP – VIP). DNS của web sẽ trỏ về cái VIP này.

- Ở trạng thái bình thường, máy Master liên tục phát đi các gói tin quảng bá (VRRP advertisements) qua mạng nội bộ để báo rằng nó đang hoạt động.

- Nếu Master ngừng hoạt động đột ngột, máy Backup không nhận được tín hiệu VRRP sẽ lập tức mở một cuộc bầu cử (election).

- Máy Backup tự động thăng cấp thành Master mới, tiếp quản địa chỉ VIP. Nó sẽ lập tức phát đi một thông báo ARP Broadcast vào mạng để ép định tuyến trỏ về địa chỉ MAC của mình.

Toàn bộ quá trình failover diễn ra trong vài giây, đảm bảo traffic của user được chuyển hướng tức thời mà không cần chờ cập nhật DNS cache.

Cơ chế Zero-Downtime Failover: Keepalived tự động chuyển giao Virtual IP (VIP) sang node Backup khi Master gặp sự cố.

Câu hỏi thường gặp (FAQ)

1. HAProxy và Nginx: Đâu là sự lựa chọn tốt nhất để làm Load Balancer?

Dùng Nginx nếu bạn cần một Web Server kiêm Proxy để phục vụ file tĩnh (ảnh, web). Dùng HAProxy nếu bạn cần một Load Balancer thuần túy để gánh tải siêu nặng (đặc biệt là TCP/Database ở Layer 4) nhờ kiến trúc siêu nhẹ và chuyên biệt.

2. HAProxy hỗ trợ tối đa bao nhiêu kết nối?

Về lý thuyết kiến trúc, HAProxy có thể gánh tới 2 triệu requests/giây (đã được benchmark thực tế). Tuy nhiên, trên môi trường Production, giới hạn này bị quyết định bởi 2 yếu tố vật lý: Lượng RAM của máy chủ và giới hạn tệp mở (fs.file-max) của nhân Linux.

3. Cấu hình maxconn bao nhiêu là đủ cho một VPS Linux?

Trung bình 1 kết nối TCP tốn khoảng 33 KB RAM. Nếu VPS của bạn dành ra 1GB RAM trống cho HAProxy, mức cấu hình an toàn là 20.000 – 25.000 kết nối. Bắt buộc phải set cứng thông số này để tránh VPS bị cạn RAM (OOM).

4. Roundrobin và Leastconn: Nên chọn thuật toán phân tải nào?

Chọn Roundrobin nếu traffic là các request HTTP xử lý nhanh và các VPS có cấu hình bằng nhau. Chọn Leastconn nếu ứng dụng có các phiên kết nối dài (WebSocket, Database) hoặc các tác vụ nặng (Export file) để tránh dồn việc vào server đang bận.

5. Tôi có cần khởi động lại (Restart) HAProxy khi cập nhật chứng chỉ SSL không?

Tuyệt đối KHÔNG. Lệnh restart sẽ cắt đứt mọi luồng dữ liệu đang chạy. Luôn dùng lệnh systemctl reload haproxy (Hitless Reload) để nạp SSL hoặc file cấu hình mới mà không làm mất dù chỉ 1 gói tin.

6. Lỗi 503 Service Unavailable qua HAProxy nghĩa là gì và cách khắc phục?

Lỗi này báo hiệu HAProxy không tìm thấy bất kỳ máy chủ Backend nào đang hoạt động. Nguyên nhân thường do Backend ngừng hoạt động, Firewall chặn kết nối nội bộ, hoặc cấu hình Health Check (httpchk) bị sai. Mở ngay trang HAProxy Stats Dashboard để truy vết server lỗi.

Kết luận

Việc thành thạo cấu hình HAProxy Load Balancer là một mốc trưởng thành lớn trong sự nghiệp của một System Engineer/DevOps. Nó chuyển đổi hệ thống của bạn từ một kiến trúc mỏng manh, dễ quá tải thành một khối hạ tầng phân tán, chịu tải khổng lồ và có khả năng tự phục hồi (auto-healing) mạnh mẽ.

3 Lời khuyên cuối cùng dành cho bạn:

- Monitor liên tục: Đừng chỉ cài HAProxy rồi bỏ đó. Hãy thiết lập các cảnh báo (alert) thông qua Datadog, Zabbix hoặc Prometheus khi biến

scur(sessions current) tiến gần đến mứcmaxconn. - Đừng lạm dụng Sticky Session: Trừ phi ứng dụng của bạn là hệ thống cũ không hỗ trợ Redis Session, hãy cố gắng build Backend ở trạng thái Stateless (Phi trạng thái). Gắn cứng một user vào một server sẽ làm hỏng bản chất chia tải đều của Load Balancer.

- Tối ưu Sysctl định kỳ: Khi traffic tăng gấp 10 lần, file cấu hình HAProxy không sai, nhưng nhân Linux của bạn có thể sẽ cạn kiệt tài nguyên. Luôn theo dõi các tham số mạng của OS.